数据智能系列讲座第05期

大型基础模型在生成式人工智能领域中发挥着重要作用,但同时面临显著的局限性。这些局限性包括在适应不可预测的真实世界方面的挑战,如应对分布外数据、噪声输入以及安全问题。其次,鉴于其对社会产生的巨大影响,推动跨学科合作以评估其潜在的利益与风险,深化人机交互的理解,并倡导负责任的人工智能应用尤为重要。在此次报告中,王晋东博士将分享他在这些关键领域的最新研究成果、见解和未来计划,探索如何在利用大型基础模型的强大功能的同时应对其局限性,并在快速变化的环境中推动负责任的AI整合。

大型基础模型在生成式人工智能领域中发挥着重要作用,但同时面临显著的局限性。这些局限性包括在适应不可预测的真实世界方面的挑战,如应对分布外数据、噪声输入以及安全问题。其次,鉴于其对社会产生的巨大影响,推动跨学科合作以评估其潜在的利益与风险,深化人机交互的理解,并倡导负责任的人工智能应用尤为重要。在此次报告中,王晋东博士将分享他在这些关键领域的最新研究成果、见解和未来计划,探索如何在利用大型基础模型的强大功能的同时应对其局限性,并在快速变化的环境中推动负责任的AI整合。

虽然近年来神经网络,特别是预训练的基础模型研究得到了广泛的应用,但其仍然主要依赖于在大量样本上的批量式训练。本报告将探讨实现模型的增量式训练,针对深度神经网络在增量式学习新任务时所面临的"灾难性遗忘"问题,介绍如何在预训练的基础模型上进行连续学习,包括基于重放的遗忘抑制机制、基于模型高效微调的连续学习框架,以及连续学习在计算机视觉上任务上的应用和部署等。

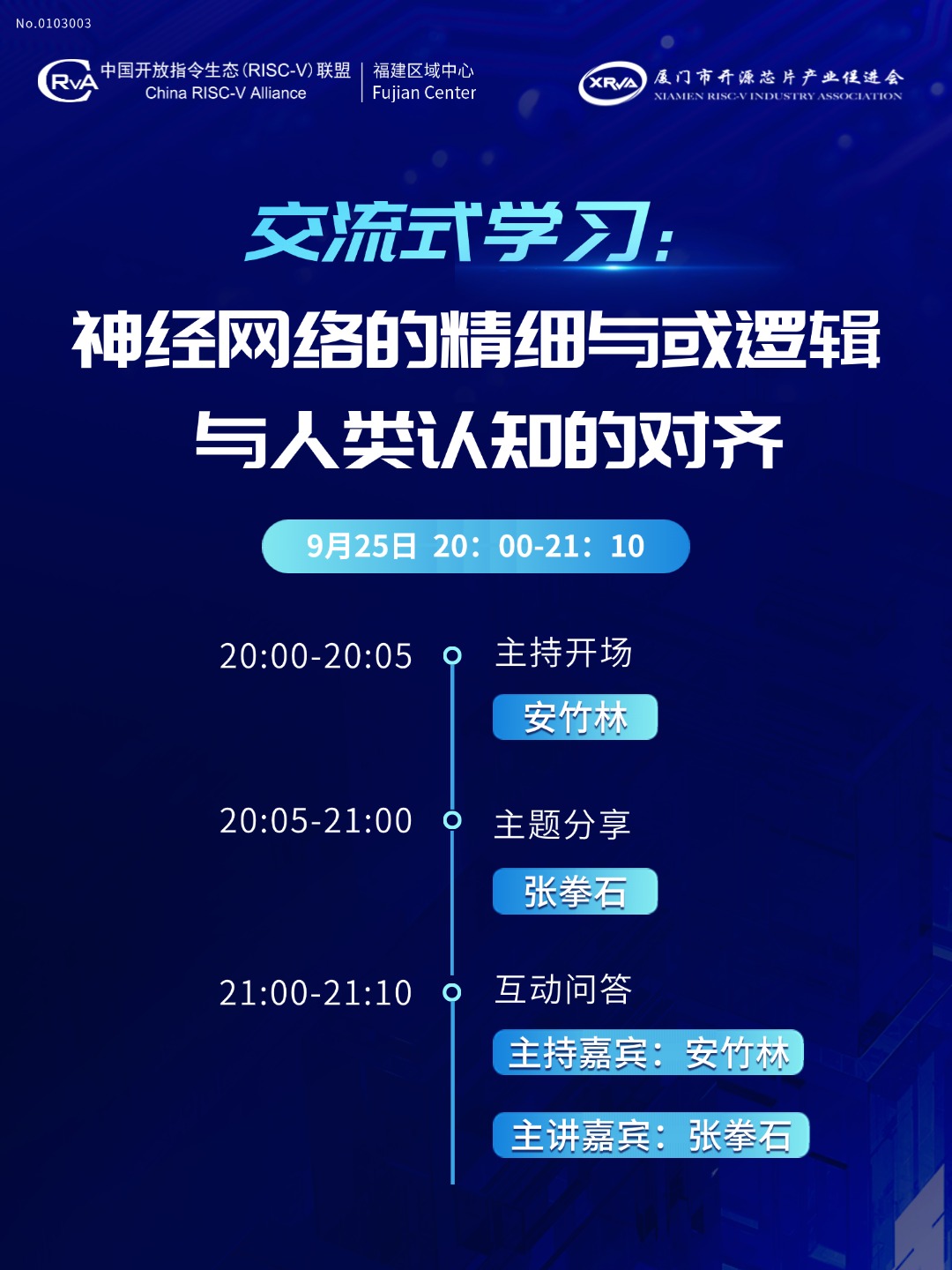

虽然近年来神经网络的可解释性研究得到了广泛的关注,但是神经网络中精细决策逻辑尚未得到有效的解释,学界对神经网络的评测依然停留在检验神经网络输出结果的层面。对神经网络精细决策逻辑的量化评测,以及神经网络决策逻辑与人类认知的对齐,为可解释性基础理论提出了新的挑战,比如证明神经网络内在决策逻辑是否可以被严谨地解释为符号化的概念,如何量化神经网络的知识表征,等等。本次报告将介绍如何在博弈交互理论体系下严谨地量化神经网络所建模的概念表征,证明解释的严谨性,进而对大模型安全性进行量化评估,实现神经网络的精细与或逻辑与人类认知的对齐。

元宇宙到底是在炒概念还是真有前景?人工智能现有的技术能力是否足以支撑其发展? 本次讲座将带你走进元宇宙的殿堂,解密人工智能将如何驱动元宇宙。

视觉骨干模型研究前沿与探讨